大语言模型进步神速,但也存在一些问题,比如这些AI聊天机器人很多时候会出现“幻觉”,即说出错误的事实、涉及有害的话题或导致安全风险。为了避免这种状况,英伟达在周二推出了一款名为NeMo Guardrails开源软件,可以确保如ChatGPT等以大语言模型(LLMs)为基础的AI应用程式能够准确、适当、切题且安全地回答问题,算是帮助软件开发者给 AI 模型设置“护栏”,防止它们产生不良的输出。

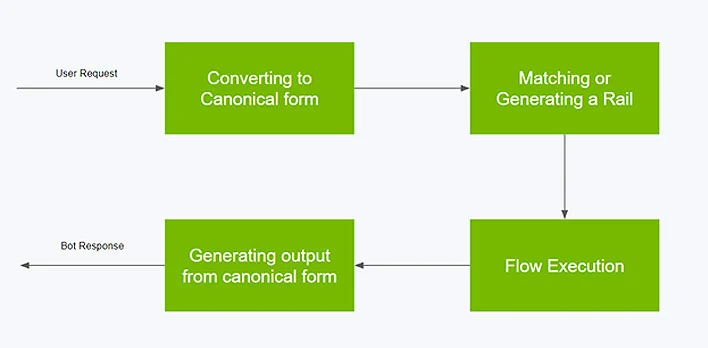

NeMo Guardrails 是开源的,并通过英伟达服务提供,可以用于商业应用,开发者将使用 Golang 编程语言来为 AI 模型编写自定义规则。该软件包含了企业为提高可以生成文本的AI应用程序的安全性所需的所有代码、示例和文档,可以让开发者调整LLM驱动的应用,以确保模型的驱动的智能应用准确、恰当、符合主题且安全,以及模型在公司的专业领域内。

NeMo Guardrails功能一览

- 主题护栏:可以避免应用偏离到不想要的领域。例如,它们可以防止客户服务助理回答关于天气的问题。

- 安全护栏:确保应用回覆准确、适当的资讯。它们可以过滤不必要的语言,并强制要求只引用可信的来源。

- 保全护栏:限制应用仅与已知为安全的外部连结建立连接。

因为NeMo Guardrails开源,NeMo框架的大部分内容已在GitHub上作为开放源码提供,所以它可以与企业应用开发人员使用的所有工具搭配使用。比如,NeMo Guardrails可以在开源工具包LangChain上运行,越来越多的开发者用LangChain将第三方应用嵌入到LLM中。

博文:https://blogs.nvidia.com/blog/2023/04/25/ai-chatbot-guardrails-nemo