文章目录[隐藏]

与AI实时无缝互动一直是开发者和研究人员面临的复杂任务。一个重大挑战在于将多模态信息(如文本、图像和音频)整合到一个连贯的对话系统中。尽管大型语言模型(如 GPT-4)取得了显著进展,但许多人工智能系统在实现实时对话流畅性、上下文意识和多模态理解方面仍遇到困难,这限制了它们在实际应用中的有效性。此外,这些模型的计算需求使得在没有大量基础设施的情况下实现实时部署变得具有挑战性。

Fixie AI 的解决方案:Ultravox v0.4.1

Fixie AI 推出了 Ultravox v0.4.1,这是一系列专门为与 AI 进行实时对话而训练的多模态开源模型。Ultravox v0.4.1 旨在克服实时 AI 交互中的一些最紧迫的挑战,它包含了处理多种输入格式的能力,如文本、图像和其他感官数据。

这个最新版本旨在为像 GPT-4 这样的闭源模型提供一种替代方案,不仅关注语言熟练度,还致力于实现不同类型媒体之间的流畅、具有上下文意识的对话。通过开源,Fixie AI 还旨在民主化访问最先进的对话技术,允许全球的开发者和研究人员适应和微调 Ultravox 以用于多种应用——从客户支持到娱乐。

技术细节和关键优势

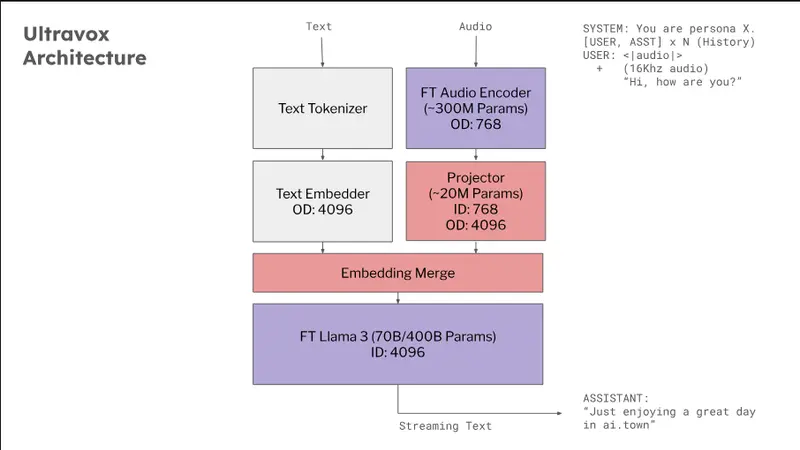

- 基于 Transformer 的架构:

- Ultravox v0.4.1 模型是使用基于 Transformer 的架构构建的,该架构经过优化,可以并行处理多种类型的数据。

- 跨模态注意力:

- 利用一种称为跨模态注意力的技术,这些模型可以同时整合和解释来自各种来源的信息。这意味着用户可以向 AI 展示一张图片,输入一个问题,然后实时收到一个信息丰富的回答。

- 开源和易访问:

- 开源模型托管在 Hugging Face 上的 Fixie AI,便于开发者访问和实验模型。Fixie AI 还提供了一个文档齐全的 API,以便于无缝集成到实际应用中。

- 低延迟和高性能:

- 该模型具有令人印象深刻的延迟减少,使得交互几乎可以立即发生,使其适用于实时场景,如现场客户互动和教育援助。根据最近的评估,Ultravox v0.4.1 实现了显著降低的响应延迟——比领先的商业模型快大约 30%,同时保持了相当的准确性和上下文理解。

- 多模态能力:

- 模型的跨模态能力使其适用于复杂用例,例如在医疗保健中将图像与文本整合进行全面分析,或提供丰富的交互式教育内容。

- 社区驱动开发:

- Ultravox 的开源性质促进了持续的社区驱动开发,增强了灵活性并促进了透明度。通过减轻部署这些模型相关的计算开销,Ultravox 使高级对话 AI 更易于小型实体和独立开发者使用,弥合了之前由资源限制强加的差距。

结论

Fixie AI 的 Ultravox v0.4.1 标志着 AI 社区在实时对话 AI 方面的重大里程碑。凭借其多模态能力、开源模型权重以及降低响应延迟的重点,Ultravox 为更具吸引力和更易获得的 AI 体验铺平了道路。随着越来越多的开发者和研究人员开始尝试 Ultravox,它有望促进对实时、上下文丰富和多模态对话有需求的行业的创新应用。无论是客户支持、教育、医疗保健还是娱乐,Ultravox v0.4.1 都为未来的对话式 AI 系统开辟了新的可能性。