共计 349 个字符,预计需要花费 1 分钟才能阅读完成。

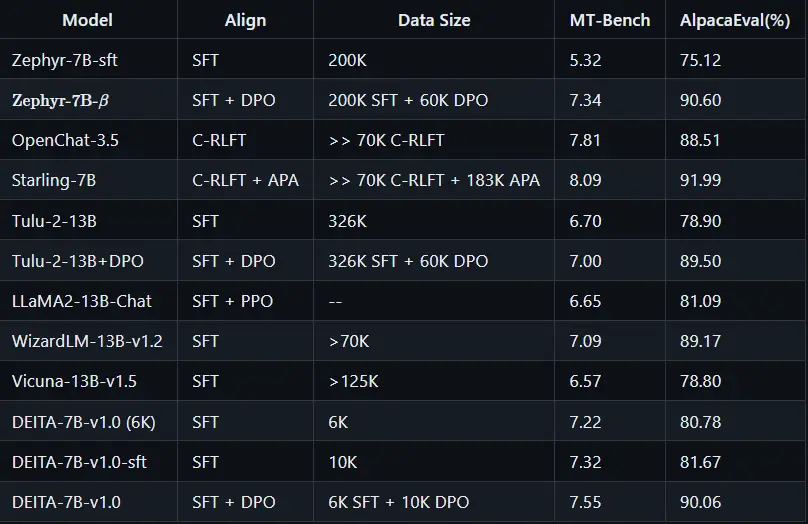

Deita 是一个开源项目,旨在为大型语言模型(LLM)的指令调优提供自动数据选择的支持。目前开源了 6K 和 10K 大小高质量数据,用 10K 数据微调的 Mistral 7B 模型,MT-Bench 得分 7.55,AlpacaEval 得分 90(超过 openchat-3.5)

该项目包括:

- 用于指令调优中自动数据选择的开源工具包

- Deita 数据集:一系列极轻量级、高质量的对齐 SFT(语言 - 代码)数据。我们在首次发布中提供了 6k 大小和 10k 大小的数据集。

- Deita 模型:与最先进的聊天型 LLM(语言模型)相媲美的一系列强大模型,具有极高效的指令调优过程。相比其他最先进的 LLM,使用 Deita 模型只需要 10 倍少的指令调优数据进行训练。

GitHub 地址:https://github.com/hkust-nlp/deita

正文完

关注公众号获取最新教程

发表至:无分类

2023-12-30